(Jeff Dean镇楼)

近日,来自UC Berkeley/Waymo/Google的科研人员利用280多万张图像训练了一个Block-NeRFs的网格,这是迄今为止最大的神经场景表征,能够渲染旧金山的整个街区 。

上图展示的街区是旧金山Alamo Square,面积约 ,数据集由专业的数据采集车分别于2021年6/7/8月采集完成,总共采集了1330次,共计13.4个小时,数据集共分成35个Block-NeRFs。

摘要

题目: Block-NeRF: Scalable Large Scene Neural View Synthesis

主页: waymo.com/research/block-nerf

论文: arxiv.org/abs/2202.05263

本文提出的Block-NeRF是神经辐射场NeRF的一个变种,利用它可以表示大规模的环境。具体来说,本文阐述了在扩展NeRF渲染跨越多个街区的城市规模的场景时,将场景分解为单独训练的NeRF是至关重要的。这种分解将渲染时间与场景大小解耦,使渲染能够扩展到任意大的环境,并允许每块环境的单独更新。本文采用了一些架构上的变化,使NeRF对在不同环境条件下数月内采集的数据具有鲁棒性。本文为每个单独的NeRF增加了外观嵌入( appearance embeddings)、学习位姿精化以及可控的曝光,并引入了一个相邻NeRF之间的外观对齐算法,以便它们可以无缝地结合起来。本文团队利用280万张图像训练了一个Block-NeRFs的网格,创造了迄今为止最大的神经场景表征,能够渲染旧金山的整个街区。

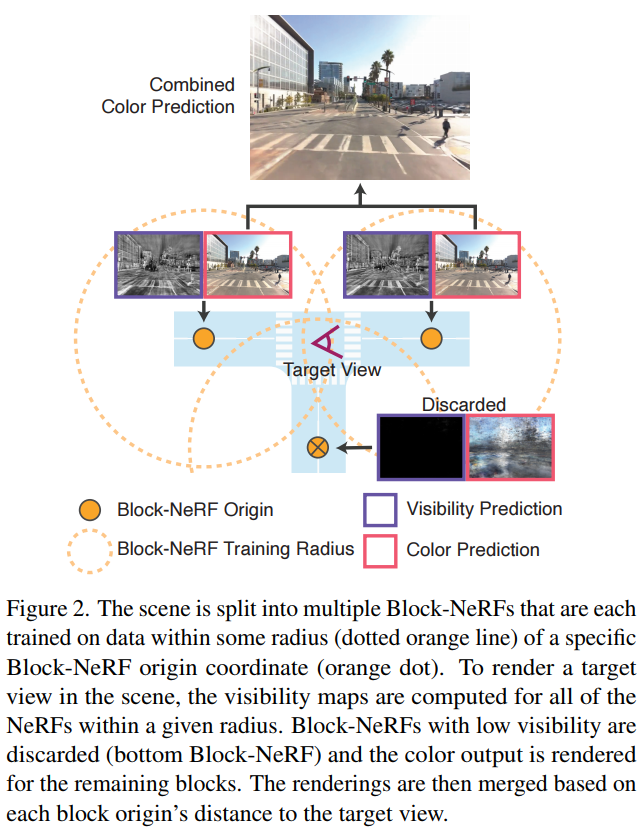

图2. 场景被分割为多个Block-NeRFs,每个Block-NeRF都基于特定Block-NeRF原点坐标(橙色点)的某个半径(橙色虚线)内的数据进行训练。要在场景中渲染目标视图,将计算给定半径内所有NeRF的共视图。共视程度低的Block-NeRF将被丢弃(上图中最下面的NeRF),其余Block的颜色输出将被渲染。然后根据每个Block-NeRF原点到目标视图的距离合并渲染

图2. 场景被分割为多个Block-NeRFs,每个Block-NeRF都基于特定Block-NeRF原点坐标(橙色点)的某个半径(橙色虚线)内的数据进行训练。要在场景中渲染目标视图,将计算给定半径内所有NeRF的共视图。共视程度低的Block-NeRF将被丢弃(上图中最下面的NeRF),其余Block的颜色输出将被渲染。然后根据每个Block-NeRF原点到目标视图的距离合并渲染 图3. 本文的模型是mip-NeRF中提出的模型的扩展。第一个MLP 预测空间中位置的密度。Block-NeRFs还输出与观察方向、曝光度和外观嵌入相连接的特征向量。这些被输入第二个MLP ,该输出该点的颜色。此外,本文还训练了一个可见性网络来预测空间中的一个点在训练视图中是否可见,该网络用于在推理过程中剔除可见程度低的Block-NeRFs

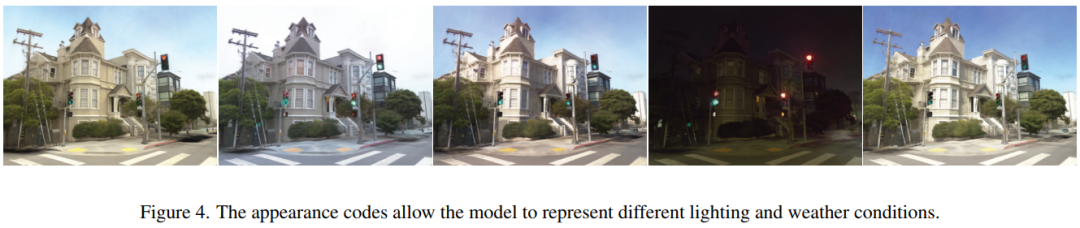

图3. 本文的模型是mip-NeRF中提出的模型的扩展。第一个MLP 预测空间中位置的密度。Block-NeRFs还输出与观察方向、曝光度和外观嵌入相连接的特征向量。这些被输入第二个MLP ,该输出该点的颜色。此外,本文还训练了一个可见性网络来预测空间中的一个点在训练视图中是否可见,该网络用于在推理过程中剔除可见程度低的Block-NeRFs 图4. 外观codes允许模型代表不同的照明和天气条件

图4. 外观codes允许模型代表不同的照明和天气条件 图5. 本文模型以曝光程度为条件,这有助于解释训练数据中存在的曝光变化。这允许用户在推理过程中以人类可理解的方式改变输出图像的外观

图5. 本文模型以曝光程度为条件,这有助于解释训练数据中存在的曝光变化。这允许用户在推理过程中以人类可理解的方式改变输出图像的外观 图6. 当基于多个Block-NeRFs渲染场景时,本文使用外观匹配来获得整个场景的一致性外观。给定一个Block-NeRFs的固定目标外观(左图),我们优化相邻的Block-NeRFs的外观,使之匹配。在这个例子中,外观匹配可以得到整个街区外观一致的夜间场景

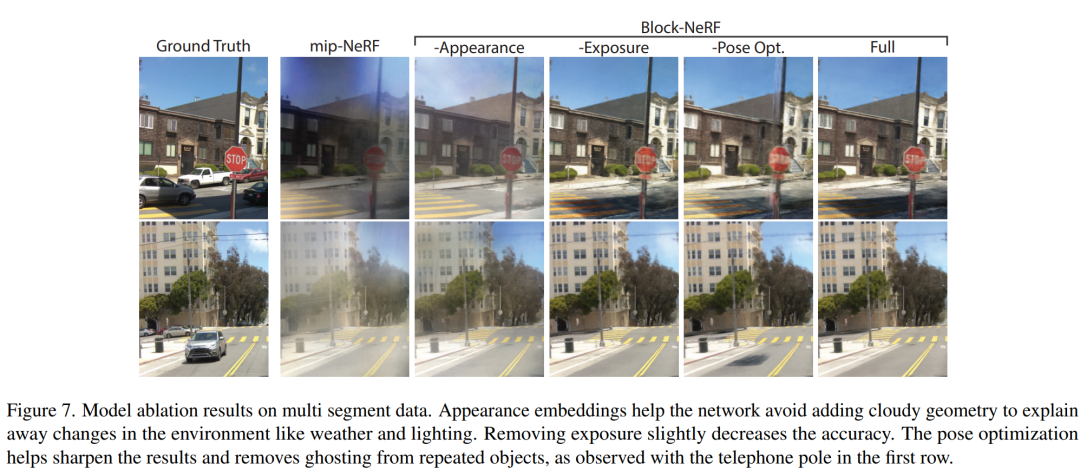

图6. 当基于多个Block-NeRFs渲染场景时,本文使用外观匹配来获得整个场景的一致性外观。给定一个Block-NeRFs的固定目标外观(左图),我们优化相邻的Block-NeRFs的外观,使之匹配。在这个例子中,外观匹配可以得到整个街区外观一致的夜间场景 图7. 多段数据的模型消融实验结果。外观嵌入帮助网络避免添加混浊的几何图形来解释环境中的变化,如天气和光照。去除曝光会稍微降低准确性。姿势优化有助于锐化结果,并消除重复物体的重影,如第一行中的电线杆

图7. 多段数据的模型消融实验结果。外观嵌入帮助网络避免添加混浊的几何图形来解释环境中的变化,如天气和光照。去除曝光会稍微降低准确性。姿势优化有助于锐化结果,并消除重复物体的重影,如第一行中的电线杆实验结果

1.Grace Cathedral

2.Lombard Street

3.Alamo Square Neighborhood

4.Moscone Center (night and day)

5.View of Bay Bridge from Embarcadero St.

6.Alamo Square block

7.Downtown block

8. 补充

本文介绍并不详细,各位感兴趣的同学请阅读原文。

来自吃瓜群众的评论

众网友一片crazy/Incredible/impressive ...

这位网友说"在NeRF中看到最喜欢的bar让人心情大好!"

"GTA:真实世界版加载已完成 50%..."

也有网友推荐了来自KITTI 360驾驶数据集,NeRF重建的工作越来越多,统一的标准确实比较重要.

当然也有质疑的声音,这位网友表示近日Mega-NeRF刚开源,并质疑了“迄今最大NeRF”的说法...

还有网友希望在将来NeRF帮助谷歌街景可以把自己模糊一下...