2月11日,智猩猩策划推出的「DeepSeek大解读」系列公开课第一期顺利完结。大模型+AI芯片专家、中存算董事长陈巍博士以《DeepSeek V3/R1架构的深度分析与深度思考》为主题,从MoE模型架构与低比特训练框架创新的角度,深入分析了DeepSeek V3/R1的架构、训练流程和训练框架设计思想,并给出了大模型发展路线和算力芯片范式共生的深度思考。

“DeepSeek绕开NVIDIA CUDA垄断”引起了巨大争议,进而把PTX推到了台前。实际上,PTX是NVIDIA GPU最底层的控制语言,由于其非常接近硬件层导致学习门槛较高,NVIDIA提供了CUDA来帮助开发者简化开发流程。所以本质上来说,PTX仍是CUDA工具链的核心组件。

DeepSeek团队的技术突破在于,通过直接编写PTX代码绕过CUDA高级抽象层,实现了对GPU硬件资源的深度优化。这一方法向业界展示了硬件资源深度挖掘、多维度性能优化和编程范式转变的可能性。

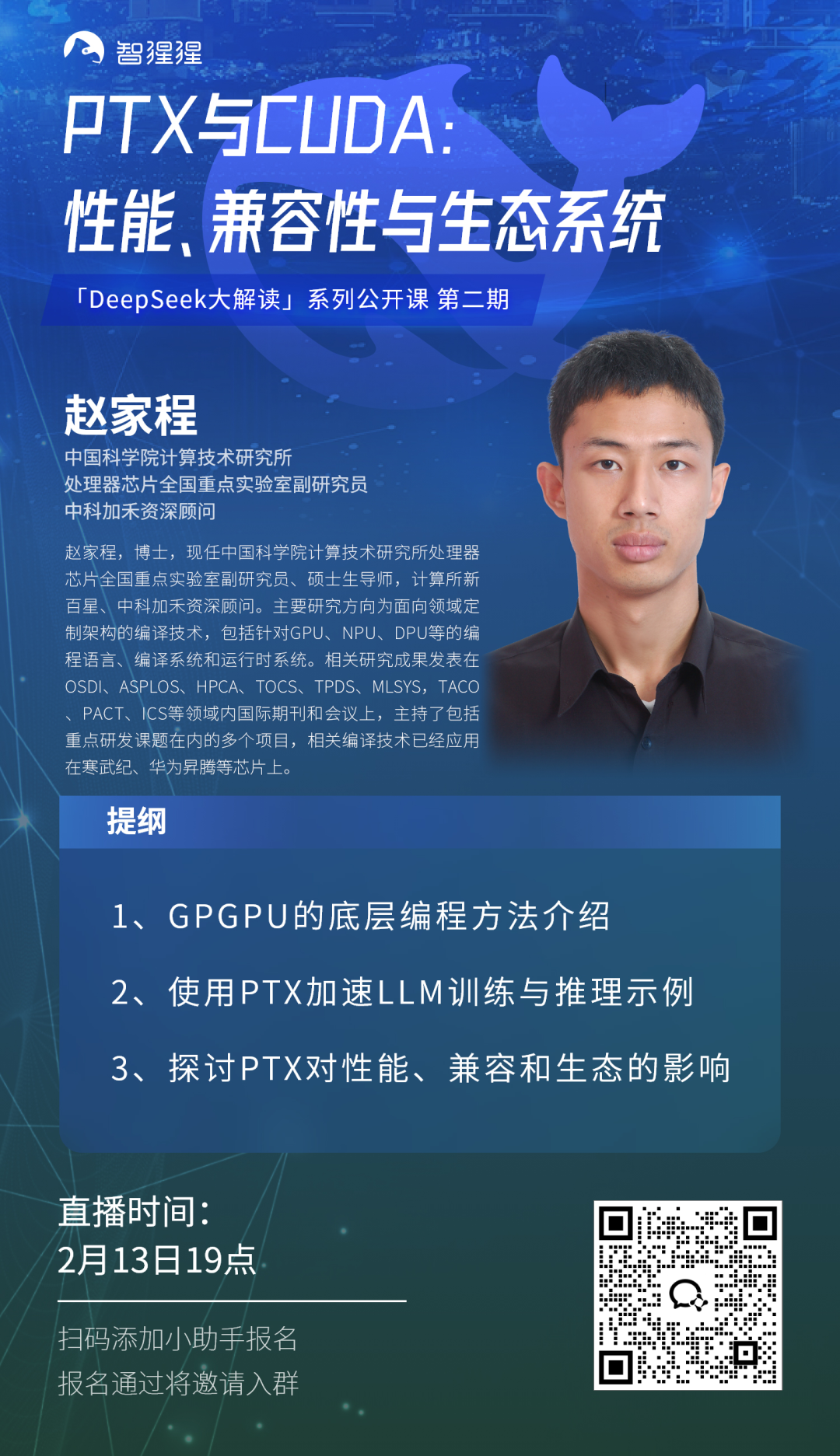

2月13日19点,中国科学院计算技术研究所处理器芯片全国重点实验室副研究员、中科加禾资深顾问赵家程博士将围绕PTX与CUDA,带来「DeepSeek大解读」系列公开课第二期的讲解,主题为《PTX与CUDA:性能、兼容性与生态系统》。

本次公开课,赵家程博士首先会介绍GPGPU底层编程方法,并分享使用PTX加速LLM训练与推理的示例,最后还将深入探讨PTX对性能、兼容性和生态系统的影响。

第2期信息

主 题 :PTX与CUDA:性能、兼容性与生态系统

提 纲 :

1、GPGPU的底层编程方法介绍

2、使用PTX加速LLM训练与推理示例

3、探讨PTX对性能、兼容和生态的影响

主 讲 人

赵家程,博士,现任中国科学院计算技术研究所处理器芯片全国重点实验室副研究员、硕士生导师,计算所新百星、中科加禾资深顾问。主要研究方向为面向领域定制架构的编译技术,包括针对GPU、NPU、DPU等的编程语言、编译系统和运行时系统。相关研究成果发表在OSDI、ASPLOS、HPCA、TOCS、TPDS、MLSYS,TACO、PACT、ICS等领域内国际期刊和会议上,主持了包括重点研发课题在内的多个项目,相关编译技术已经应用在寒武纪、华为昇腾等芯片上。

直 播 时 间

2月13日19:00-20:00

如何报名与入群

对于「DeepSeek大解读」系列公开课第二期,有直播观看需求的朋友,可以扫描下方二维码添加小助手“小石头”,私信发送“DeepSeek02”进行报名,报名通过后将分享直播地址。

针对此次公开课,也会组建交流群。希望入群与更多同仁探讨的,也可以与“小石头”进行申请。