智猩猩AI整理

编辑:没方

Agentic AI 正在成为人工智能领域最具变革性的研究方向之一。这类具备自主规划能力、能够灵活调用工具并与环境持续交互的智能体,正从早期的实验室原型逐步走向复杂真实场景中的规模化应用(如Claude Code与OpenClaw),其核心特征也从“回答生成”转向“驱动决策与行动”。在这一范式演进背后,Agentic RL正逐渐成为关键技术支柱。不同于传统的 RLHF,Agentic RL 强调在多轮交互环境中,通过可验证反馈与序列决策优化,让大语言模型(LLM)具备持续决策、动态规划与自我修正的能力,从而真正支撑复杂任务中的长期推理与执行。

在这一背景下,中国科学技术大学认知智能全国重点实验室率于2025年年初开源发布了 Agent-R1 训练框架。近期,Agent-R1 正式迎来 v2 版本的重要升级,目前项目在 GitHub 上的 Star 数已突破 1300+。相较于首代版本,Agent-R1 v2 在底层系统架构、Trajectory 表示机制以及多轮训练策略等方面实现了系统性重构,不仅提升了复杂任务下的稳定性与训练效率,也显著增强了智能体在开放环境中的泛化能力与鲁棒性,进一步推动 Agentic RL 从研究探索走向可落地的工程实践。

- 论文标题:Agent-R1: Training Powerful LLM Agents with End-to-End Reinforcement Learning

- 论文链接:https://arxiv.org/pdf/2511.14460

- 项目地址:https://github.com/AgentR1/Agent-R1

01 研究背景:RL for LLM 的三次进化

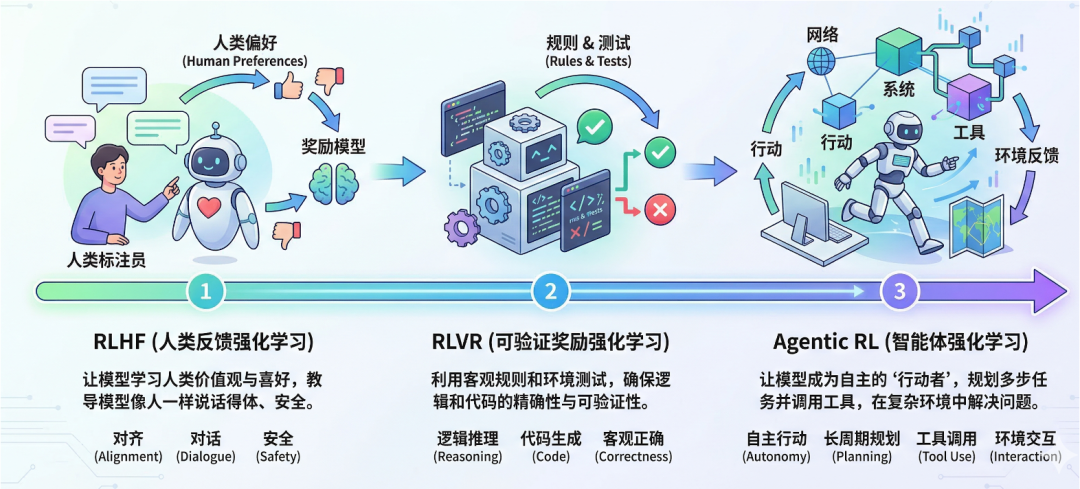

近年来,强化学习与大语言模型的结合正快速演进,并逐步形成一条从“对齐”到“推理”再到“行动”的清晰技术路径:

第一代:RLHF(Reinforcement Learning from Human Feedback) 以 InstructGPT、ChatGPT 为代表。这一阶段的核心在于利用人类反馈对模型进行行为对齐:通过人工标注偏好数据,训练奖励模型,再借助 PPO 等方法优化模型输出,使其在表达上更加符合人类价值与安全规范。然而,这类方法高度依赖人工信号,成本较高,且奖励往往具有主观性与模糊性,因此在数学推理、程序生成等需要客观正确性的任务上存在一定局限。

第二代:RLVR(Reinforcement Learning with Verifiable Rewards) 以 DeepSeek-R1 等工作为代表。该阶段的重要转变在于引入可验证的客观奖励机制,如代码是否成功执行、数学结果是否正确等,从而摆脱对人工打分的依赖。这一范式显著提升了模型在逻辑推理与结构化任务中的表现,并促进了长链推理(Long Chain-of-Thought)的涌现。不过,这类方法仍主要聚焦于“单体推理”,模型多在封闭环境中进行推断,与外部环境的动态交互相对有限。

第三代:Agentic RL(Agent-oriented Reinforcement Learning) 这是当前正在兴起的前沿方向,也是 Agent-R1 所聚焦的核心范式。在这一阶段,大模型从“文本生成器”转变为“任务执行者”:不仅能够生成内容,还可以主动调用工具、感知环境反馈、调整决策策略,并在多轮交互中逐步完成复杂任务。其奖励信号直接来源于任务完成情况,状态空间扩展为“上下文 + 环境”,动作空间也由“token 生成”拓展为“工具调用与行动决策”,从而更贴近真实世界中的决策过程。

从整体来看,这三代技术演进反映出强化学习在大模型中的作用不断深化:从最初的行为对齐(Alignment),到强调推理能力(Reasoning),再到迈向决策与行动(Action),逐步推动大模型从“会说话”走向“能做事”。

02 Agent-R1框架介绍

1、从 R1 到 Agent-R1

DeepSeek-R1 通过长链思维(CoT)解决逻辑复杂问题,本质是一种静态的内生推导——模型只在自己的"脑袋里"想,不与外界互动。

Agent-R1 引入了 Agentic RL 范式,核心在于三点升级:

- 工具调用:不再只是写代码,而是实际运行并根据错误日志迭代修正。

- 闭环反馈:将外部环境(API、数据库、浏览器)的真实反馈作为 MDP 状态输入。

- 长期规划:在动态变化的环境中进行多轮决策,具备更强的鲁棒性。

| 维度 | R1(推理模型) | Agent-R1(智能体) |

| 奖励来源 | 数学/逻辑一致性 | 任务达成率 |

| 动作空间 | 文本 Token 生成 | 文本 + 外部工具指令调用 |

| 状态空间 | 上下文 Context | 上下文 + 环境实时反馈 |

2、Agent-R1框架概览

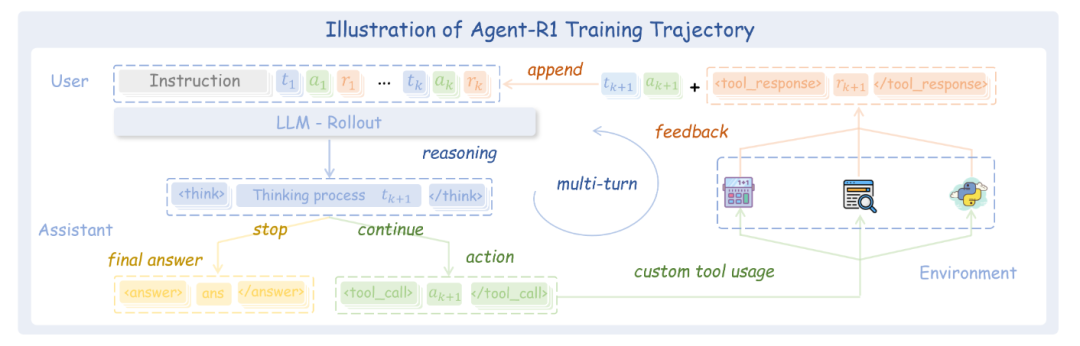

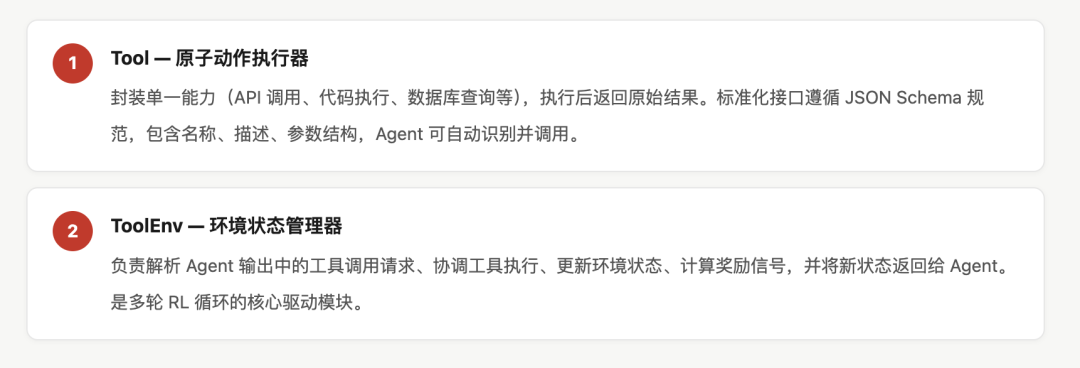

Agent-R1 将传统单轮 RL 训练框架扩展为支持多轮交互 Rollout 的完整系统, 核心由 Tool 与 ToolEnv 两个模块构成。

Agent-R1 训练轨迹示意图

如上图所示,Agent 在 Rollout 阶段进行多轮推理与工具调用,接收环境反馈,最终用完整轨迹进行 RL 更新。

(1)两大核心模块

(2)关键训练机制

(3)训练后端的统一优雅视角

Agent-R1 的训练后端设计极为简洁,背后藏着一个重要洞见:无论是单轮问答,还是跨越数十步的"思考-工具-反馈"多轮交互,在训练层面都只是一条 Token 序列。具体而言:

- 通过 Loss Mask 区分 Prompt 与 Response,训练只对模型生成的 token 计算梯度,工具返回的内容不参与更新。

- 训练后端接收一个带有 Mask 的张量,执行标准前向传播获取 Logits。

- 损失计算过程与 SFT(监督微调)完全一致,唯一的区别是每个 token 的交叉熵损失会乘以一个标量——Advantages。

这意味着 RL 训练的复杂性被完全封装在 Advantages 的计算中,训练后端本身无需感知智能体的多轮交互逻辑,从而实现了采样与训练的彻底解耦。

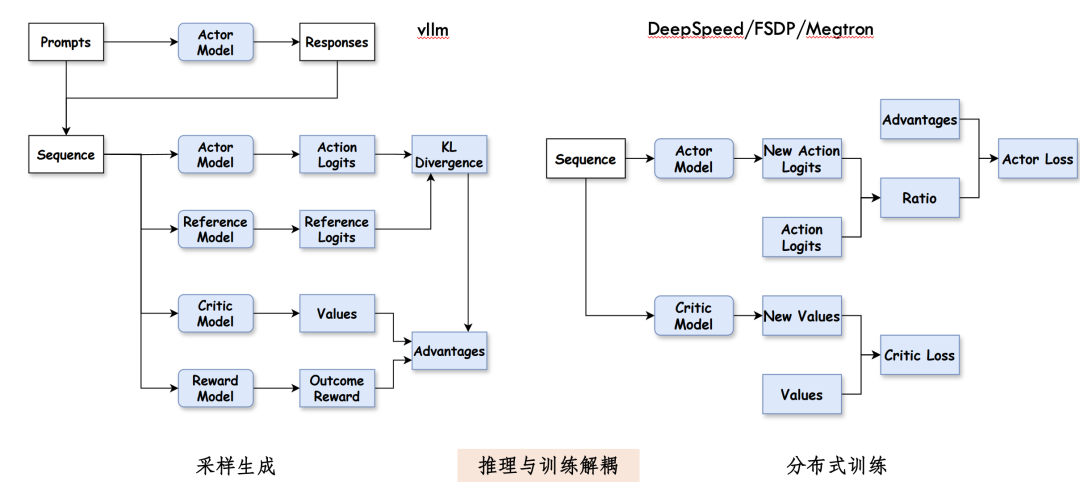

(4)分布式训练架构:推理与训练解耦

Agent-R1 采用业界成熟的分布式训练链路,将采样生成与梯度更新彻底解耦:

- 采样端:基于 vLLM,高效并行地完成多轮 rollout 轨迹收集。

- 训练端:支持 DeepSpeed / FSDP / Megatron,适配不同规模的算力集群。

- 算法支持:GRPO、PPO 等主流 RL 算法均已集成。

03 实验结果

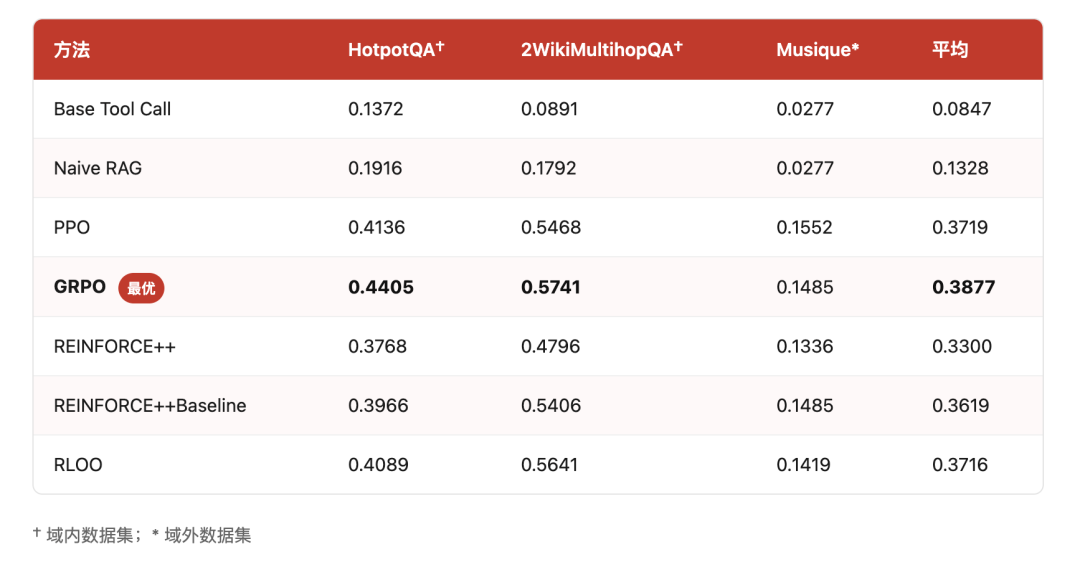

所有 RL 训练方法均大幅超越基线:最弱的 RL 算法(REINFORCE++,平均 EM 0.33) 仍比 Naive RAG(0.13)高出约 2.5 倍。GRPO 综合表现最优, PPO 在域外 Musique 数据集上表现突出,展现了良好的泛化能力。

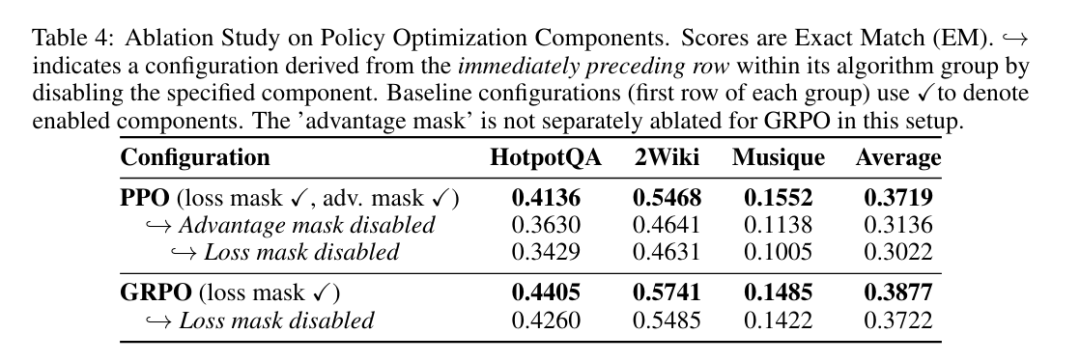

消融实验证明 Action Mask(用于损失计算与优势对齐) 是 Agent-R1 框架中最关键的设计之一。 去掉 loss mask 或 advantage mask 均会导致性能显著下降, 说明精确的信用分配对多轮 Agent 训练至关重要。

04 本次Agent-R1 v2版本更新

Step-level MDP:多轮任务的正确建模方式

传统单轮 RL 将任务退化为多臂赌博机问题,无真实中间状态转移。Agent-R1 v2 提出 Step-level MDP,恢复了完整的序列决策特性:

- 每一轮交互都是一个真实的状态转移。

- 奖励信号同时包含过程奖励和结果奖励。

- 支持跨越数十步"思考-工具-反馈"的长程信用分配。

这使得模型能从真正意义上学习"怎么做",而不仅仅是"说什么"。

Layered Abstractions:开发者友好的分层设计

v0.1.0 全面重构了代码库,引入分层抽象设计:

- 研究者可以自定义工具与交互环境,快速构建新任务。

- 支持多模态输入,不局限于文本场景。

- 与 verl 生态完全兼容,复用成熟的 RL 训练基础设施。

05 回顾Agent-R1中三代轨迹表示方案的演进

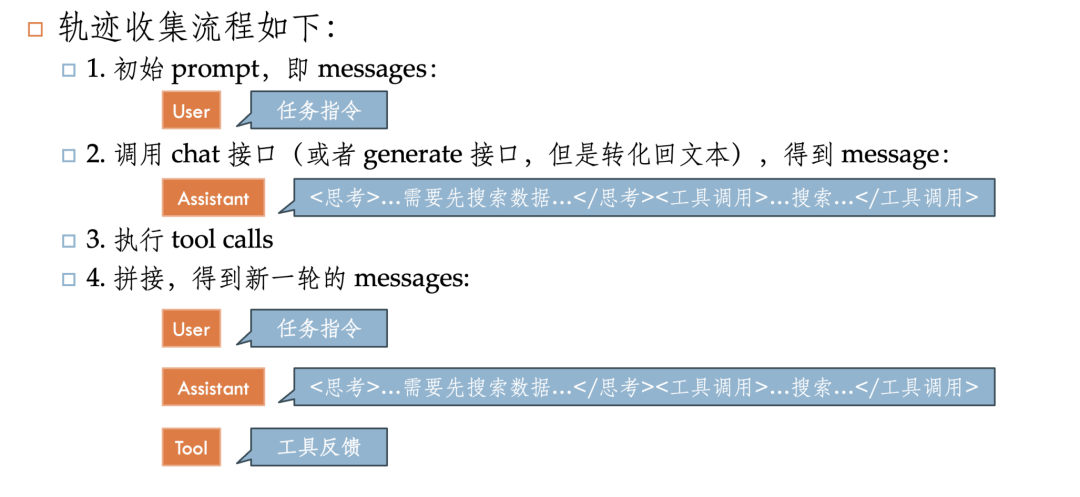

如何在多轮工具调用中准确收集训练轨迹,是 Agentic RL 的核心工程难题。Agent-R1 经历了三代方案的演进:

第一代:Messages

- 优势:直觉清晰,可直接用 OpenAI chat 接口

- 问题:存在 Retokenization Drift——文本 decode 再 encode 过程不可逆,导致 token 对齐漂移,影响训练稳定性

第二代:Token-In-Token-Out

- 全流程直接拼接 token ids,精细控制 mask

- 优势:rollout 与训练完全对齐,训练稳定

- 问题:与实际部署(chat 接口)存在不一致,思考内容处理复杂

第三代(v2 最新):Step-based Sequence

- 一条完整轨迹由多个 step 组成,每个 step 对应一个单轮 (prompt, response, reward)

- 优势:实现极简,无需复杂 token 拼接;训练部署 100% 完全一致;支持高度灵活的上下文压缩/重写;支持 rollout 训练完全解耦(黑盒模式)

从 RLHF 到 RLVR,再到 Agentic RL,大模型强化学习的演进路径正逐步清晰:强化学习赋予大模型的,不仅是“更强的推理能力”,更是在真实环境中进行决策与行动的能力。

Agent-R1 v2 的发布,尝试在这一范式下迈出关键一步:通过 step-level MDP 重构多轮任务的建模方式,以 step-based sequence 缓解训练与推理不一致的问题,并通过分层抽象降低复杂 Agent 系统的研究与开发门槛。这些探索并非局限于单一框架优化,而是指向一个更普遍的问题——如何让大模型在开放环境中稳定地进行长程决策。

我们逐渐认识到,未来大模型能力的核心,不再只是“生成更好的答案”,而是完成真实世界中的复杂任务。在这一意义上,能够“做事”的智能体,或许将成为下一阶段人工智能最关键的研究方向之一。