智猩猩AI整理

编辑:六六

想象一下,一个数字人不仅能开口说话,还能精确到每一个唇形与声音的完美同步——这不再是科幻电影中的场景,而是 Veo3、Sora2 等前沿模型正在实现的突破。然而,其闭源特性使得其核心架构与训练范式始终笼罩于黑箱之中,成为制约领域发展的关键壁垒。

为弥合可访问性与生成效果之间的差距,华为研究团队联合提出了 UniTalking——统一的端到端扩散框架,能够同时生成自然流畅的语音和唇形精准同步的视频。更进一步,UniTalking 创新性地支持个性化语音克隆,仅凭简短音频参考即可生成目标风格的语音。

充分的定性与定量实验表明,所提方法能够生成极具真实感的说话人视频,在唇形同步精度、音频自然度及整体感知质量等多个维度上全面超越现有开源方法。

论文标题:UniTalking: A Unified Audio-Video Framework for Talking Portrait Generation

论文链接:https://arxiv.org/pdf/2603.01418v1

01 UniTalking框架

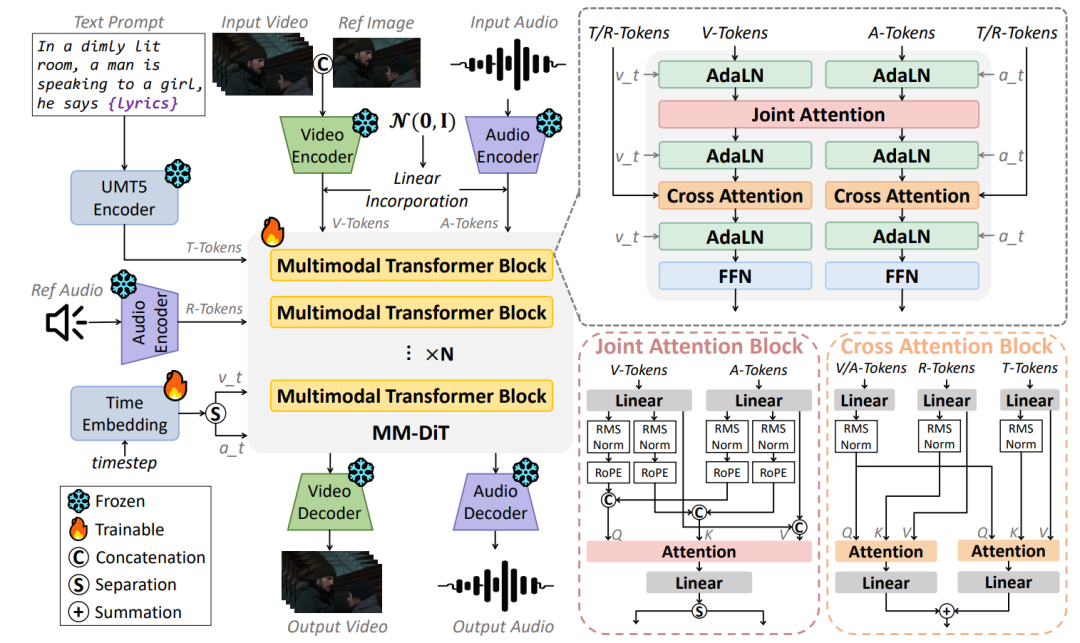

UniTalking 的架构如图 1 所示,基于多模态 Diffusion Transformer 构建。整个框架作为连续归一化流(Continuous Normalizing Flow ),使用流匹配(Flow Matching)目标函数进行训练,并由 Classifier-Free Guidance 技术引导控制。

图 1 UniTalking架构图。

为利用大规模预训练优势,视频分支沿用视频基模 Wan2.2-5B 的架构与权重,为视觉合成提供强大先验。本框架的关键创新在于:为弥合模态间表示差距,音频分支被设计为与视频分支完全相同的孪生结构。该架构的对称性促进异构模态潜空间的对齐,音频分支参数随机初始化并通过单独预训练匹配视觉分支的理解生成能力。

1. 潜变量表示

视频与音频潜变量:视频帧经 Wan2.2 的 3D 因果 VAE 编码,实现 时空压缩率。音频采用 MMAudio 的 1D VAE,原始波形经短时傅里叶变换为梅尔频谱图(Mel-spectrogram)后编码。推理时,去噪后的音频潜变量解码为梅尔频谱图,由 BigVGAN 声码器合成 44.1kHz 波形。

条件潜变量:文本提示由冻结的 UMT5 模型嵌入,参考音频由相同的冻结MMAudio VAE编码。该冻结编码器为 MM-DiT 块提供稳定且语义丰富的潜空间。

2. 多模态 Transformer 模块

为整合多模态条件并增强时序连贯性,对标准 DiT 块进行三处改进:

联合注意力:将自注意力替换为联合注意力机制,拼接音视频潜变量 token,使模型在单次操作中联合建模模态内与模态间依赖,提升音视频协同理解。

增强交叉注意力:为融合文本与参考音频条件,新增针对参考音频的键-值投影层。主 token 分别关注各条件,输出逐元素相加融合,确保生成内容既符合文本语义又保持参考音频风格。

各向异性位置编码:采用差异化旋转位置嵌入策略:沿时间轴应用标准 RoPE,但对音频 token 的空间维度使用单点派生 RoPE。该设计引导模型聚焦时序动态,强化音视频流间对齐。

02 数据

数据集源自 OpenHumanVid 及内部数据。筛选后为每个音视频对生成多粒度文本标注及参考音频,用于后续训练。最终数据集包含230万个对齐音视频样本。

参考数据生成:模型支持以参考人声为条件合成。采用 IndexTTS2 生成训练对:以原始视频音频为音色参考,结合随机文本提示(单词与数字序列),合成 3-5 秒参考音频。每段视频重复三次以扩充数据。

03 训练策略

针对预训练视频分支与随机初始化音频分支间的不平衡,提出两阶段渐进训练策略以实现稳定收敛。

1. 音频分支预训练

首先在文本到语音任务上隔离训练音频分支,联合优化有无音色参考两种合成条件。为保持其他模态表示,采用参数高效微调:冻结文本与视频分支所有参数(含前馈网络和注意力投影层),仅更新音频输入投影层、音频分支前馈网络及注意力投影层。

2. 多任务联合音视频训练

基于训练好的音频分支,端到端训练 UniTalking 框架,通过多任务学习交替执行文本到音视频(T2AV)、文本-视频到音频(TV2A)、文本-图像到音视频(TI2AV)及文本-参考到音视频(TR2AV )任务,迫使模型学习模态间双向关系以实现精准唇形同步。

其中,T2AV 建立粗粒度脚本对齐;TV2A 引入音频至视频注意力掩码,提供单向监督使模型基于真实视频特征预测音频,直接学习视素到音素的细粒度映射;其余两项任务则实现个性化生成。

04 评估

1. 结果可视化

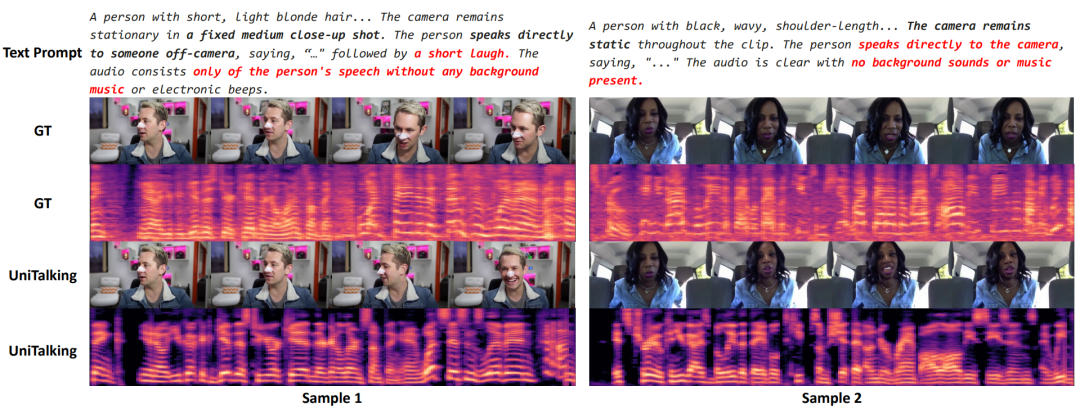

音视频同步:统一音视频生成领域的一个基本挑战在于两种模态之间的时序对齐。为展示模型生成结果的对齐质量,图 2 可视化了随机选取样本的视频帧和音频梅尔频谱图。通过比较视频帧与梅尔频谱图的变化,可以观察到生成视频中的说话人像表现出准确的唇形同步。此外,将 UniTalking 生成音频的梅尔频谱图与真实音频进行比较,两者展现出高度相似的模式,表明生成的语音完全准确。

图 2 生成音视频说话人像与真实音视频数据的视频帧及梅尔频谱图可视化。上方为对应的文本提示,特定关键词以加粗红色突出显示。生成视频与音频在语义上与真实数据保持一致。

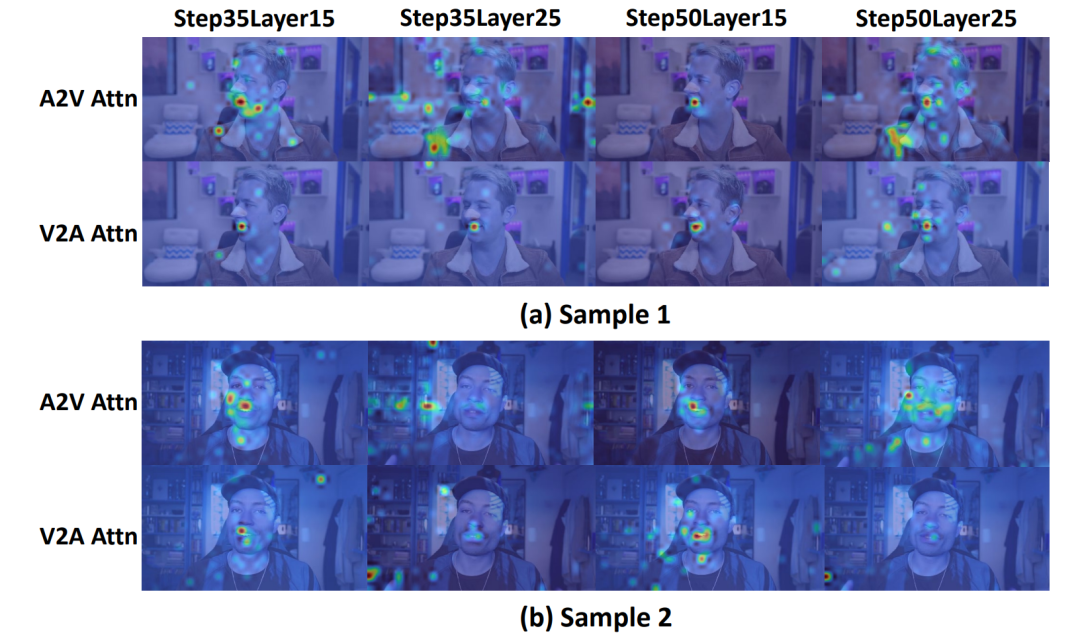

交叉注意力可视化:为进一步阐明 UniTalking 中视频与音频模态之间的相关性,图 3 展示了通过不同层中联合注意力模块得到的视频与音频 token 间的注意力图。注意力图揭示了视频与音频模态之间存在清晰的依赖关系,语义相关区域被赋予更高的权重。音频到视频的注意力图表明,面部和身体区域受益于音频 token。反之,视频到音频的注意力图则表明,音频 token 仅受益于唇部区域。

图 3 联合注意力中视频 token 与音频 token 间注意力图的可视化。子图 (a) 和 (b) 分别展示两个不同的随机样本。子图中第一行表示音频到视频的注意力,第二行表示视频到音频的注意力。不同列对应来自不同推理采样步骤及不同变换器模块的权重。

2. 实验结果

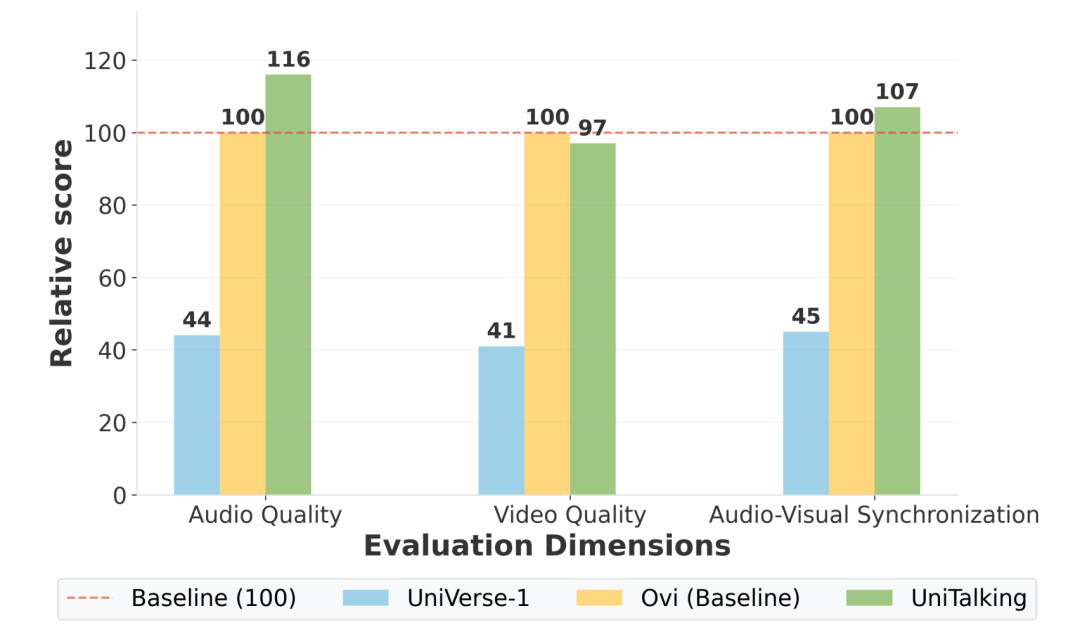

文本到音视频任务的盲对偏好研究:针对文本到音视频任务进行主观评估,以 OVI 为基线,计算各模型在视频质量、音频质量及音视频同步上的胜率,公式为 。如图 4 所提方法在音频质量和音视频同步上表现最佳,相较 OVI 胜率达 116% 和 107%;视频质量与 OVI 相当。鉴于两者均基于预训练 Wan 2.2,该结果合理。

图 4 三个指标(视频质量、音频质量和音视频同步)的盲选偏好研究结果。将OVI的结果归一化至100作为基线,其他方法报告其相对分值。

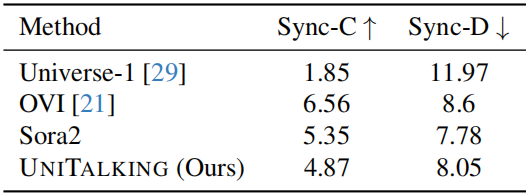

客观对比采用Sync-C和Sync-D指标:如表 1 所示,所提方法在 Sync-C 上超越 Universe-1 达 3.02 分,性能与 Sora2 相当;Sync-D上分别超越 Universe-1 和 OVI 3.92 和 0.55 分。

表 1 T2AV任务唇形同步评估结果

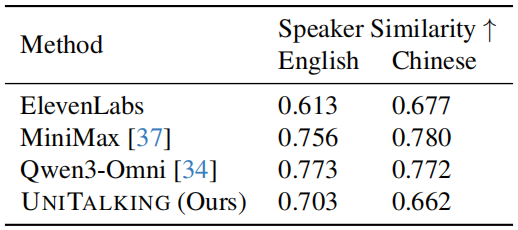

参考相似度评估:表 2 展示了音色相似度对比实验结果。与 Qwen3-Omni保持一致,选取 ElevenLabs、MiniMax 及 Qwen3-Omni 作为对比方法。结果表明,所提方法具备一定程度的语音克隆能力。尽管难以超越最先进的大规模音频模型性能,UniTalking仍实现了与ElevenLabs相当的语音相似度。

表 2 TR2AV 任务说话人相似度评估结果。 UniTalking所使用的文本提示对视频描述进行了补充。