智猩猩AI整理

编辑:汐汐

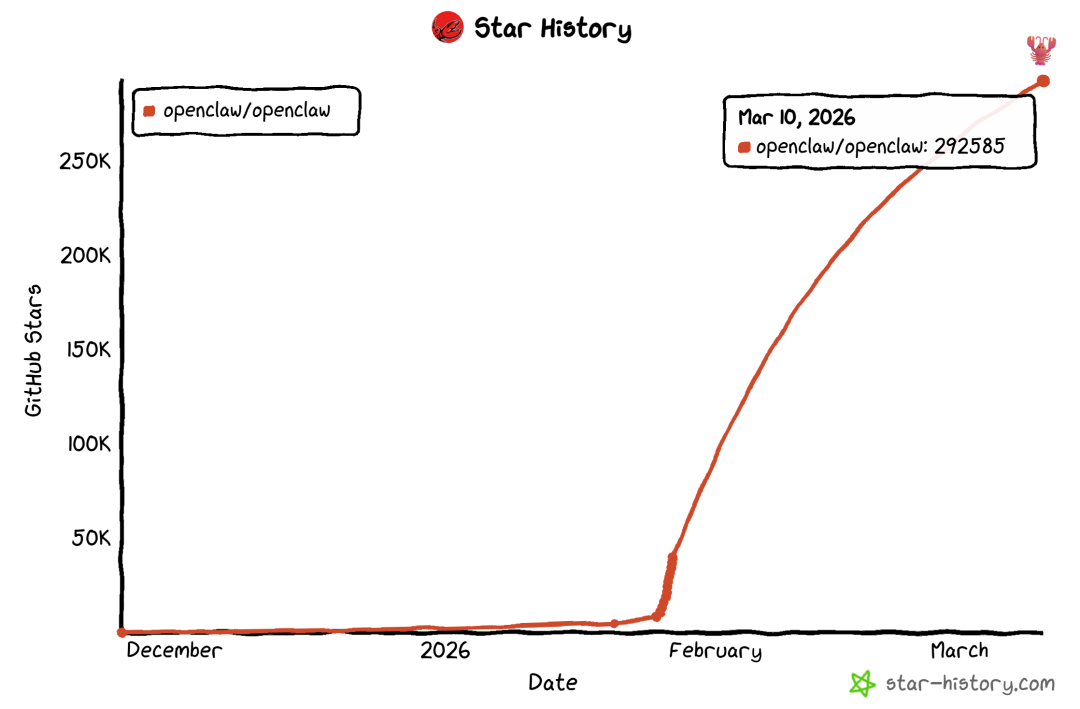

OpenClaw,这款由开发者@steipete主导的开源本地 AI Agent 框架,自上线以来便以本地优先理念席卷 GitHub。目前仓库星标已达接近30万,fork也超5.5万,贡献者几百人,刷新了开源项目增长纪录。

在 AI Agent 赛道从“聊天工具”向“自主执行体”演进的关键窗口,OpenClaw以完全本地运行、多平台消息接入(WhatsApp、Telegram、Slack、Feishu等20+通道)、工具调用与持久记忆为核心,迅速成为开发者构建生产级智能体的首选。开源 Agent 生态正从单一模型 wrapper 转向可插拔、多智能体协作架构,而 OpenClaw 正处于这一浪潮中心。

就在过去两天(2026 年 3 月 8 日与 9 日),项目作者 @steipete 连续推送 v2026.3.7 与 v2026.3.8 两个重大版本,再次点燃龙虾热潮。

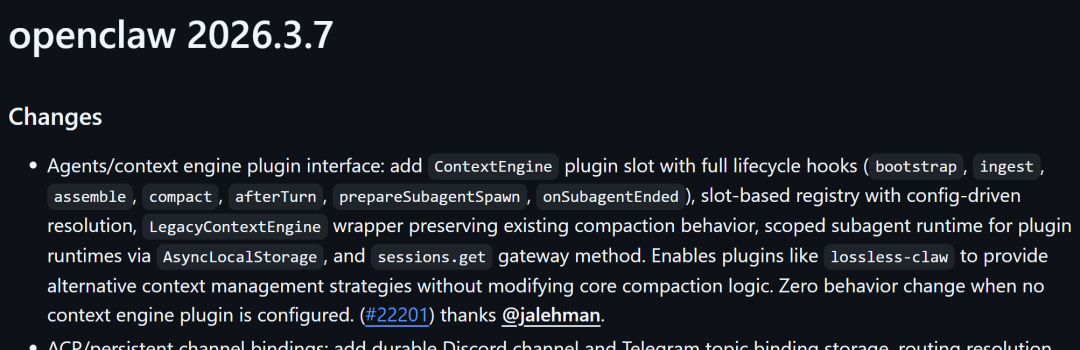

01 连续两次密集更新:ContextEngine插件化接口正式落地

v2026.3.7(3 月 8 日发布) 的核心是ContextEngine 插件化接口的正式落地。这不是简单的 prompt 优化,而是对 Agent 记忆与上下文管理的系统性重构。更新内容多达27条,而相对重要的更新内容如下:

新增 ContextEngine 插件槽位,支持 bootstrap、ingest、assemble、compact 等全生命周期hook;

子智能体运行时隔离 + 注册表机制,实现多智能体间上下文安全共享;

配套持久化通道绑定、工具结果头尾截断、compaction 后处理配置、prompt 注入控制策略。

这些改动直接提升了 Agent 在长时任务、实时数据流(如链上监控、交易对冲)中的稳定性与可扩展性。更新同时首发支持 Google Gemini 3.1 Flash-Lite,并将 Perplexity 切换为官方 Search API,工具调用延迟与准确率显著改善。

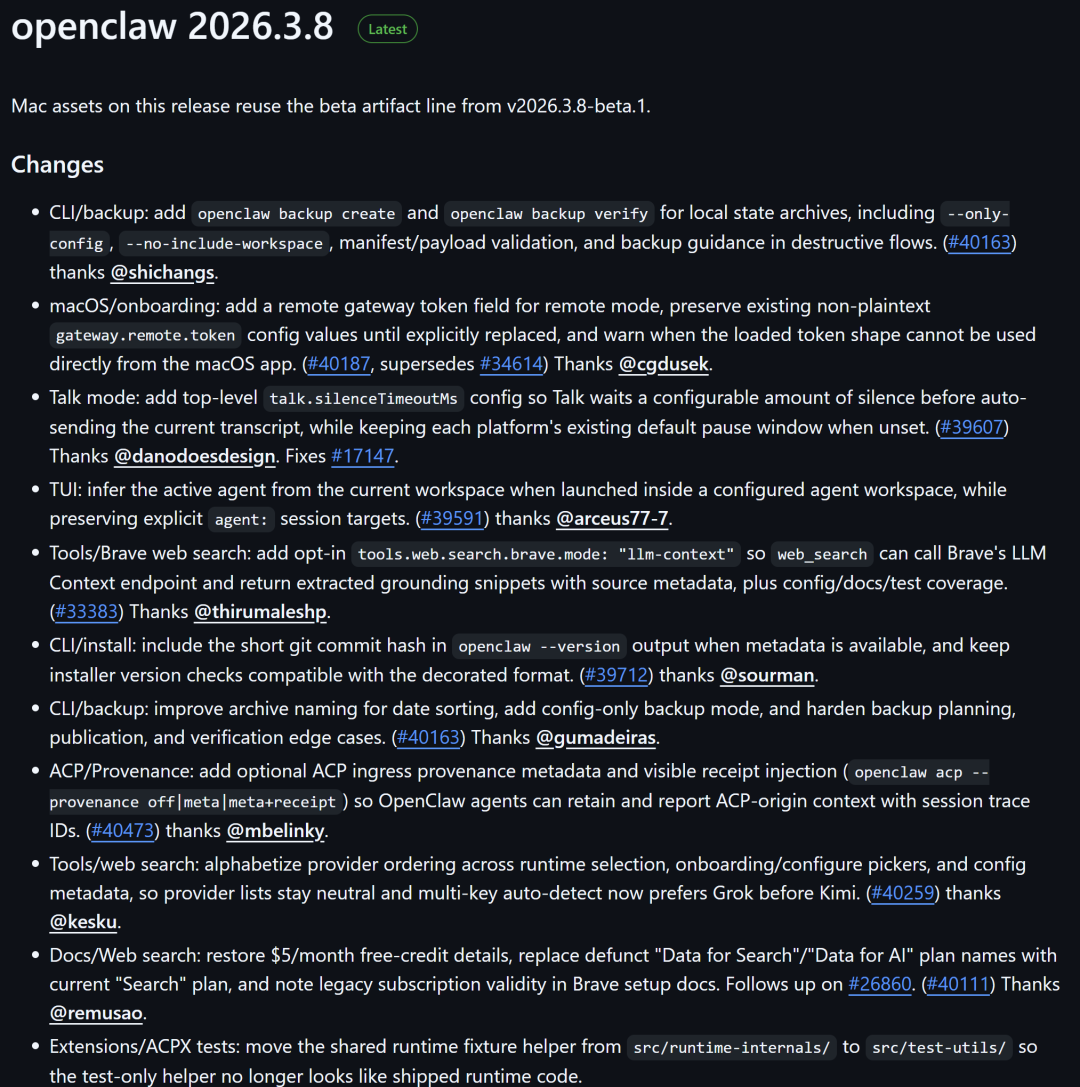

v2026.3.8(3 月 9 日发布) 则聚焦生产可用性与前沿模型适配,总共有11条更新,而主要的更新内容如下:

CLI 新增 openclaw backup create/verify 全状态归档命令,支持按需排除 workspace;

Talk 模式新增 silenceTimeoutMs 配置,语音交互更自然;

Brave Web Search 加入可选 llm-context 模式,提供 grounding snippet 与元数据;

原生前向兼容 GPT-5.4;

ACP(Agent Context Protocol)增加 provenance 元数据与 trace ID,实现端到端调用追踪。

另外,v2026.3.8更新还在安全层面做了调整,Android 权限收紧、Gateway auth 强制化、配置快照验证等补丁进一步强化本地部署的隐私和安全性。

OpenClaw的发展路线清晰,从“能聊天”到“能持久记忆、能安全协作、能无缝适配最新大模型”。两次更新共同强化了工具调用链路、记忆系统、多智能体路由,并通过模型目录自动 failover 降低了开发者适配成本。

值得一提的是,OpenClaw 之父在 X 平台发布了「OpenClaw 适配大模型榜单排行」,直观展示了不同模型在 ContextEngine 新架构下的任务成功率、上下文保持能力和工具循环效率。该榜单迅速成为社区基准讨论焦点。

02 ContextEngine让上下文可插拔:再也不用担心对话的记忆损失了

3月7日,也就是v2026.3.7版本发布前一天,@steipete在X平台发布了OpenClaw适配大模型榜单排行,直观展示各模型在全新 ContextEngine 架构下的任务成功率、上下文保持能力和工具循环效率。该榜单一经发布便成为社区基准参考,直接反映出 GPT-5.4、Gemini 3.1 Flash-Lite 等前沿模型在本地 Agent 场景下的真实表现。

(榜单详细信息查看网站https://pinchbench.com/)

而两次更新发布后,海外社交平台上针对ContextEngine插件化的讨论迅速刷屏,很多用户和开发者普遍认为,这才是“让Agent从玩具走向生产的真正转折点。

开发者做技术解读说,lossless-claw这样的项目无需做核心更改就能够实验,这完全控制了OpenClaw如何启动、获取、组装和压缩上下文。

Meta前TPM、现AI创业者@AI_Nate_SA发帖称,可插拔的上下文引擎是一个游戏规则的改变者,这无需触及核心压缩逻辑就能实现类似无损爪子这样的功能,并给予了高度的赞扬。

ByteRover作者也发帖表达了赞扬,说“再也不需要为容易丢失的上下文作斗争了”。

也有网友与OpenClaw的维护者Josh对话,问到“好奇无损爪在流程中扩展摘要时如何处理延迟。”,Josh称“使用了子智能体来扩展”,但是随着上下文的不断累计增长,还是会“越来越有损”。

YC W23 增长负责人@harshith发帖表示,上下文与智能体的核心部分解耦是社区一直想要解决的问题,而ContextEngine则解决的非常好!无损爪子方法,完美解决了代理在处理长时间任务时遇到的痛苦截断问题。

03 龙虾的“iPhone时刻”正在到来:开源Agent框架进入“基础设施级”阶段

OpenClaw连续两天高频迭代,并非一次普通的 bugfix,而是开源 Agent 框架正在从“工具集”向“可编程基础设施”完成质的跨越。ContextEngine 插件化重构彻底解耦了记忆管理与核心逻辑,让开发者第一次能够像替换操作系统内核模块一样,自定义上下文策略、持久化方案和多智能体协作模式。

当我们把目光稍稍拉长,2026 年从年初到现在,会发现GitHub 星标已逼近30万、插件生态持续爆发、ContextEngine 驱动的 lossless 长时任务成为标配,安装了龙虾的人谁不想让自己的龙虾身怀多种技能、能处理极其复杂的长时上下文任务?本地 Agent 不再是“能跑 demo”,而是真正具备工业级记忆、跨平台持久执行和零信任安全能力的数字劳动力,也是对不少玩家来说的“能真正记住你”的赛博伴侣。

龙虾已经火出圈,上至六七旬老人,下至十几岁的少年,都开始慢慢试着拥抱龙虾狂潮,QQ、微信、飞书等国内多家头部厂商也在纷纷尝试接入龙虾,KimiClaw、QClaw、miClaw、AutoClaw等各家自己的龙虾也层出不穷。隐私优先、可审计、可无限扩展的 Agent 系统,正在真正意义上从少数极客玩具变成企业和个人的默认数字基础设施。

本地Agent的iPhone时刻已经不再是预言,而是正在发生的现在进行时。

而OpenClaw,正站在浪潮的最前端。